Comment l'IA générative reconfigure la culture humaine

Comme chacun sait, les intelligences artificielles génératives sont omniprésentes aujourd'hui. C'est pour ça que tout le monde a le même style d'écriture sur LinkedIn, ou que l'on voit partout ces images générées par IA, au style artistique esthétique, mais aussi souvent très lissé et reconnaissable. Les modèles génératifs, qui génèrent de nouvelles données à partir de bruit aléatoire, imitent la création humaine. Ils se nourrissent de nos productions, et en interprètent le contenu ; avant de nous abreuver à notre tour de nouvelles productions, inspirées des nôtres, mais déformées, par le fonctionnement même des algorithmes. Et ils ne permettent pas que de générer du texte ou des images, leur champ de possibilité est en fait très vaste. Les algorithmes peuvent imiter toute forme de données, ou d'échantillons statistiques. Je me souviens par exemple que la première fois que j'ai travaillé sur des modèles génératifs on fabriquait des données médicales, de faux patients, pour ainsi avoir des données médicales à étudier sans avoir de problème de confidentialité, puisque les patients en question n'existaient pas.

L'omniprésence de l'IA générative redéfinit donc les contenus auxquels on s'habitue, transmet des biais, et nous influence profondément, tout simplement parce qu'on y est exposé à longueur de journée. Et quand bien même vous seriez un ermite qui évite toute influence extérieure, ce dont je doute puisque vous êtes actuellement en train de m'écouter, le simple fait que ça influence vos congénères a déjà un impact indirect sur vous, par le biais de l'inconscient collectif, et de la culture.

L'effet miroir

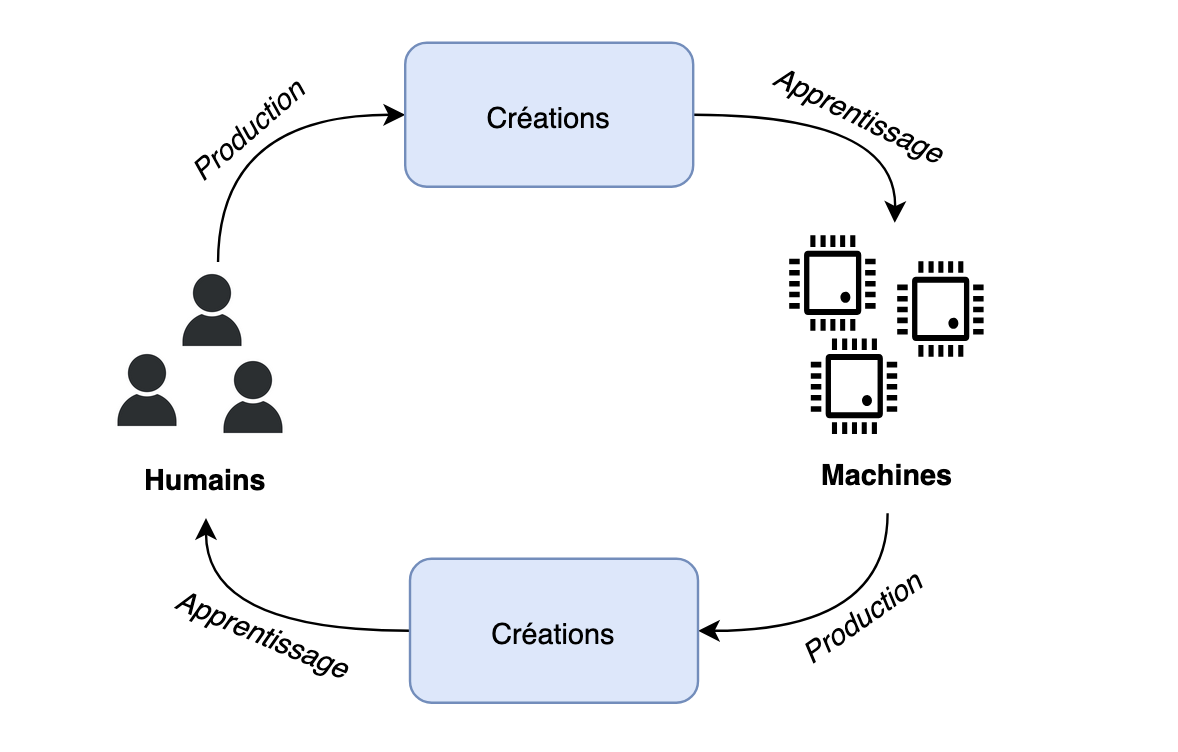

Le mécanisme en jeu est donc le suivant : L'IA est entraînée sur du contenu culturel humain : du texte, des images, du son. Ce contenu est naturellement orienté, situé historiquement, socialement et culturellement. Après son apprentissage, l'IA produit de nouveaux contenus. Ces contenus sont consommés massivement, consciemment ou non, et parfois même préférés à ceux des humains.

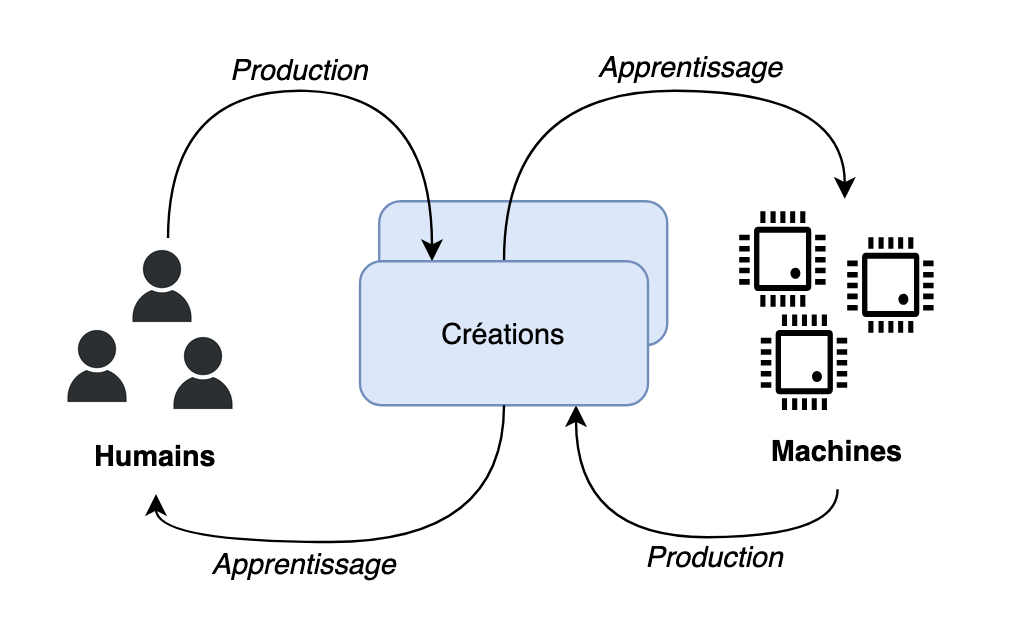

L'humain, animal mimétique, poursuit sa création, sous l'influence de ces nouveaux standards linguistiques et artistiques, création qui, à nouveau, influence les algorithmes. Peu à peu également, notre culture se mélange, se distord, s'efface, s'invisibilise. Les créations humaines et algorithmiques se mélangent et nourrissent à la fois les humains et les algorithmes.

Les conséquences culturelles

La question qui nous intéresse est donc la suivante : Que devient la culture humaine lorsqu'elle se nourrit d'elle-même à travers ce filtre algorithmique ? Ou pour le dire autrement, étant donné que l'IA générative façonne les contenus que nous consommons, que devient notre pensée, nourrie par ce miroir déformant ? Quelles sont les conséquences de cette boucle de rétroaction, de cet effet miroir ? Et ces conséquences sont-elles néfastes ou bien bénéfiques pour notre société ?

Premier risque : Propagation et amplification des biais

Les algorithmes, tout comme nous, sont biaisés. Par exemple, pour certains modèles de langage, le féminin du mot "médecin" est "infirmière". Ou encore, certains générateurs d'images représentent des chirurgiens 98% du temps comme des hommes blancs. Et même un biais minime dans les données d'origine peut être amplifié massivement une fois qu'il devient une norme ou une référence esthétique. L'IA a typiquement tendance à minimiser ce qui est minoritaire dans ses données d'apprentissage. C'est pour ça que l'éthique de l'IA est si importante. Le moindre biais peut se propager à grande échelle. Et à l'inverse, un algorithme débiaisé, si cela est possible, pourrait avoir une influence favorable à grande échelle.

Second risque : Appauvrissement de la diversité culturelle

Les modèles sont optimisés pour prédire le "plus probable". Cette recherche systématique du consensus crée un lissage des formes : mêmes progressions d'accords dans la musique, mêmes palettes de couleurs dans l'illustration, même phrasé dans l'écriture. L'IA a tendance à homogénéiser, à lisser les extrêmes. Cela risque de nous mener à un esthétisme fade, à des communications très codifiées, à une soupe au style moyen, qui plaît au plus grand nombre sans vraiment apporter de profondeur, ni cette étincelle singulière qui nous fait vibrer. Mais là encore, la médaille a son revers : cette technologie peut aussi représenter une ouverture à plus de créativité, plus d'exploration d'idées, et finalement à une richesse culturelle accrue. De l'interaction homme-machine peut jaillir des idées nouvelles, la machine nous donnant potentiellement accès à une grande diversité de pensées et d'oeuvres du monde entier.

Troisième risque : Influence sur la cognition humaine

En écho au point précédent, la standardisation du contenu pourrait influencer notre pensée. À force de déléguer l'acte de penser à la machine, on risque de réduire nos propres capacités de raisonnement. Une étude récente, conduite par le professeur Michael Gerlich, montre que les utilisateurs réguliers d'assistants génératifs obtiennent, en moyenne, des scores plus faibles à des tests d'argumentation, et voient leur esprit critique réduit. Une autre étude, signée Anil Doshi et Oliver Hauser, démontre à l'inverse qu'en s'aidant d'un modèle de langage, les participants parviennent à écrire des histoires perçues comme plus créatives et mieux écrites. Mais en même temps des histoires plus similaires les unes des autres. Ce qui semble donc plutôt aller dans le sens d'un appauvrissement et d'une uniformisation de la pensée et de la culture sous l'influence de l'IA.

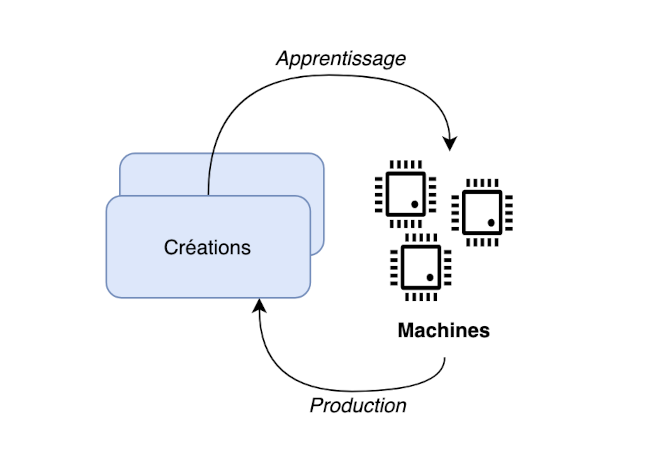

Quatrième risque : Effondrement

Derrière ce mot menaçant, effondrement, se cache en fait un concept technique bien concret. L'"effondrement de modèle" désigne la perte d'efficacité des modèles d'IA lorsqu'ils sont entraînés sur des données synthétiques produites par d'autres modèles d'IA, y compris leurs propres versions antérieures. Essentiellement, si on entraîne un algorithme sur ses propres productions, il va avoir tendance à faire disparaître les données les plus minoritaires, perdre en performance, et peu à peu produire des sorties incohérentes ou absurdes.

La sémantique disparaît du texte, et les images deviennent floues et abstraites, à l'instar des peintures de Louis Wain, ce peintre diagnostiqué schizophrène dont la dégénérescence progressive a conduit ses tableaux de chats, d'abord reconnaissables, à se transformer peu à peu en formes psychédéliques et méconnaissables.

Les multiples interactions entre algorithmes génératifs pourraient amener cet effondrement à se généraliser. Pire encore, et si l'être humain, à son tour, à force de ne consommer que des oeuvres régurgitées par l'IA, voyait lui aussi sa pensée s'effondrer ? Bon, cette hypothèse reste très spéculative, et sans doute trop alarmiste. Peut-être qu'au contraire, les multiples interactions homme-machine sont une opportunité de grandir main dans la main avec l'IA dans un cercle bénéfique et enrichissant. D'ailleurs, nous sommes depuis toujours, entre humains, dans une boucle d'interaction constante, qui a mené au langage, à l'art et aux découvertes.

Conclusion

Nos créations se reflètent dans l'algorithme ; l'algorithme reflète nos créations. Ce miroir, parfois déformant, peut tout autant amplifier nos défauts que révéler des perspectives inédites. Ce qui est néfaste, c'est que cette boucle de rétroaction, non contrôlée, généralise les stéréotypes, efface les singularités et nous pousse à ne plus penser par nous-même. De l'autre côté, il y a une opportunité enrichissante : celle d'une augmentation de la créativité, de plus de productivité, et d'une IA éthique et au service de l'humain.

En somme, l'intelligence artificielle n'est pas une technologie toute puissante. C'est un miroir de notre propre culture, qui nous laisse entrevoir notre beauté, mais également nos travers les plus sombres.

Références

Biais démographique dans les images :

https://pubmed.ncbi.nlm.nih.gov/37966807/

Biais LLM en médecine :

https://www.worthwhileconsulting.com/read-watch-listen/chatgpt-insists-that-doctors-are-male-and-nurses-female

Biais algorithmique en médecine :

https://www.fondationtrudeau.ca/activites/publications/intelligence-artificielle-medecine-biais-et-ethique

Amplification de biais :

https://arxiv.org/html/2410.15234v1

Impact de l'IA sur la réflexion :

https://www.mdpi.com/2075-4698/15/1/6

Impact de l'IA sur la créativité :

https://www.science.org/doi/10.1126/sciadv.adn5290

Éffondrement de modèle :

https://www.nature.com/articles/d41586-024-02420-7

Éffondrement de modèle (Wikipédia):

https://fr.wikipedia.org/wiki/Effondrement_de_mod%C3%A8les_d%27intelligence_artificielle